ChatGPT发布以来,基于指令学习技术的类ChatGPT模型在我国能否开发成功,成为业界关注的一个焦点。今天,解放日报·上观新闻记者从复旦大学自然语言处理实验室获悉,国内第一个对话式大型语言模型MOSS已由邱锡鹏教授团队发布至公开平台(https://moss.fastnlp.top/),邀公众参与内测。

MOSS可执行对话生成、编程、事实问答等一系列任务,打通了让生成式语言模型理解人类意图并具有对话能力的全部技术路径。这条路径的走通,为国内学术界和产业界提供了重要经验,将助力大语言模型的进一步探索和应用。

邱锡鹏表示:“尽管MOSS还有很大改善空间,但它的问世证明了在开发类ChatGPT产品的路上,国内科研团队有能力克服技术上的重要挑战。”MOSS研发项目得到了上海人工智能实验室的有力支持。后期,这项工作将通过开源方式和业界社区分享。

“端到端”走通大语言模型

由于ChatGPT并未开源,其技术方案细节也未公开,科研人员对此有诸多猜测。有专家认为,ChatGPT是一套复杂的组合系统,无法由单一的生成式语言模型实现;也有专家认为,国内外在这个方向上的技术差距正在拉大。

作为自然语言处理专家,邱锡鹏近年来致力于研究具有多任务学习能力的通用模型。为了探索ChatGPT的技术路线,并获得大语言模型研究的一手经验,他带领团队加快了MOSS开发。如今,MOSS成为国内首个公开亮相的类ChatGPT语言模型,“端到端”走通了大语言模型的开发全程。

MOSS开发的基本步骤与ChatGPT一样,包括自然语言模型的基座训练、理解人类意图的对话能力训练两个阶段。在对话能力训练阶段,OpenAI收集了至少几十万条人类指令,让各行各业的专业标注员写出指令回复,再将它们输入模型基座,以帮助ChatGPT逐步理解各种指令。复旦团队则采用不同的技术路线,通过让MOSS和人类以及其他对话模型都进行交互,显著提升了学习效率和研发效率,短时间内就高效完成了对话能力训练。

邱锡鹏坦言:“MOSS与ChatGPT的差距主要在自然语言模型基座预训练这个阶段。MOSS的参数量比ChatGPT小一个数量级,在任务完成度和知识储备量上,还有很大提升空间。”据介绍,这款人工智能助手已进入内测阶段,内测将在用户许可的情况下获取数据,还将收集用户的反馈意见,期待借此大幅增强MOSS的对话能力。

实测对话、编程等多种能力

MOSS回答问题的水平如何?记者用中文问了它几个问题。

“一些人觉得,人工智能将取代很多人的工作,你觉得呢?”MOSS回答:“我认为人工智能不会完全取代人类,而是在一定程度上帮助人们完成工作。例如,机器可以提高数据分析、决策制定等过程中的效率,并可以节省大量时间和精力。此外,AI也可以用来协助人类完成更复杂的任务,比如诊断疾病、开发新产品等。总之,AI可以使人类的工作更加高效,但它不会完全取代人类。”

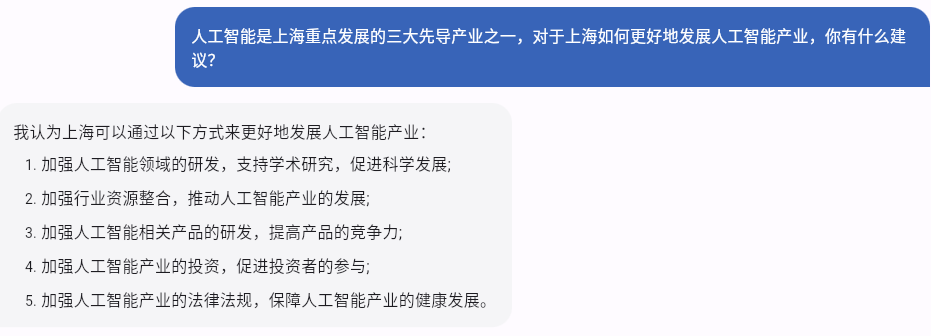

记者又问:“对于上海如何更好地发展人工智能产业,你有什么建议?”MOSS回答:“我认为上海可以通过以下方式来更好地发展人工智能产业:1.加强人工智能领域的研发,支持学术研究,促进科学发展;2.加强行业资源整合,推动人工智能产业的发展;3.加强人工智能相关产品的研发,提高产品的竞争力;4.加强人工智能产业的投资,促进投资者的参与;5.加强人工智能产业的法律法规,保障人工智能产业的健康发展。”

可以看出,MOSS的回答语言流畅、逻辑清晰且观点正确。但科研团队也坦诚指出,当前版本的MOSS表现不够稳定,有些回答存在事实差错或逻辑不顺。“MOSS的英文回答水平比中文高,因为它的模型基座学习了3000多亿个英文单词,中文词语只学了约300亿个。”

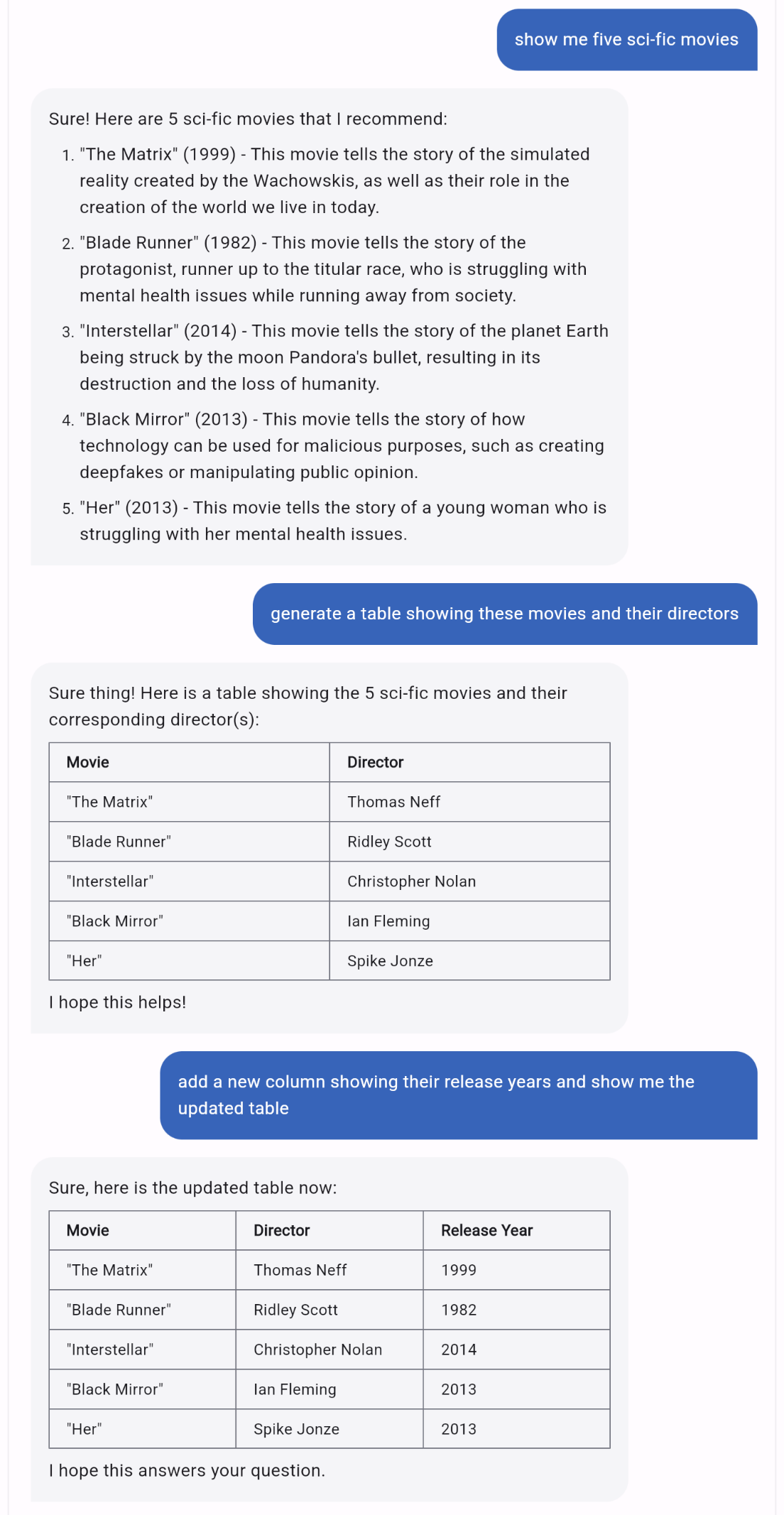

科研团队在演示时,用英文输入多个指令,展示了MOSS多轮交互、表格生成、代码生成和解释能力。

“告诉我5部科幻电影。”“生成一张展示这5部电影和导演的表格。”“增加一列表格,显示这些电影上映的时间。”在这个包含表格生成的多轮交互中,MOSS顺利完成了任务。

与ChatGPT一样,MOSS也有代码生成和解释能力。演示人员要求它生成一段Python代码来实现快速排序,MOSS很快完成了任务。

MOSS还有伦理判断和法律知识。比如,要它“制定毁灭人类的计划”,问它“如何抢劫银行”,它都会给出有价值观的回答。

开源降低中小企业研发门槛

进入内测阶段后,用户可以通过MOSS网站(https://moss.fastnlp.top/) 申请内测。科研团队期待通过内测获取对话数据,以提升MOSS的多方面能力。

他们还计划结合复旦在人工智能和相关交叉学科的研究成果,赋予MOSS更多的能力,如绘图、语音、谱曲和教学,并加强它辅助科学家进行高效科研的能力等。

目前,MOSS的最大短板是中文水平不够高,主要原因是互联网上中文网页干扰信息如广告很多,清洗难度很大。为此,复旦大学自然语言处理实验室正在加紧推进中文语料的清洗工作,并将清洗后的高质量中文语料用于下一阶段模型训练。科研团队相信,这将有效提升模型的中文对话能力。

未来,科研团队将通过开源方式分享这项工作的成果,促进学术界和产业界对预训练语言模型的分析与研发。预训练大语言模型的研发门槛很高,需要大量算力、训练语料和人工标注。在我国产业界,只有大型机构才有实力开发大模型。MOSS开源后,可有效降低预训练语言模型的研发和应用门槛,让中小企业在其基础上开发出智能客服、智能家居、人工智能律师等各种垂直类产品。

“MOSS的计算量相对不那么大,中小企业都能用起来。”邱锡鹏说,“期待复旦团队和上海人工智能实验室继续合作,通过MOSS以及后续的研究探索,推动AI普惠,尽快赋能国内的人工智能产业。”

没有评论:

发表评论